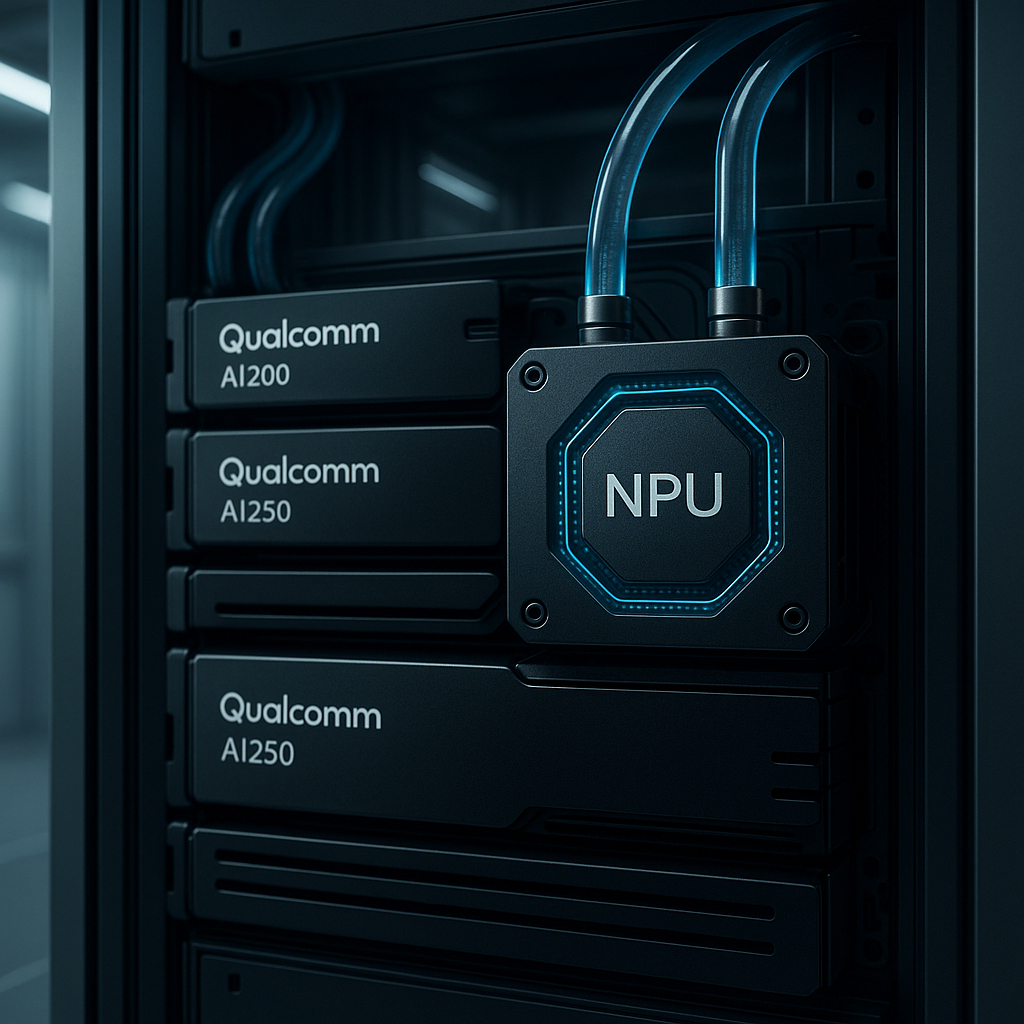

Компания Qualcomm Technologies официально анонсировала два новых решения для центров обработки данных (ЦОД), ориентированных на ИИ-инференс: стоечные суперускорители Qualcomm AI200 и Qualcomm AI250. Это событие стало важной вехой в стратегии диверсификации бизнеса компании, стремящейся снизить зависимость от рынка смартфонов и укрепить позиции в быстро растущем сегменте искусственного интеллекта. После анонса акции Qualcomm выросли на 15 % — это самый значительный внутридневной рост за последние полгода, что свидетельствует о высоком интересе инвесторов к новому направлению.

Стратегический поворот Qualcomm: от мобильных чипов к ИИ-инфраструктуре

Под руководством CEO Криштиану Амона (Cristiano Amon) Qualcomm последовательно расширяет присутствие за пределами традиционного сегмента мобильных устройств. Рост продаж смартфонов замедлился, а спрос на вычислительные мощности для ИИ-инференса стремительно растёт. В этом контексте выход на рынок ЦОД выглядит не просто логичным, а необходимым шагом.

Как отметил Дурга Маллади (Durga Malladi), старший вице-президент Qualcomm, компания «занимала эту нишу, не торопясь и наращивая мощь». Это означает, что Qualcomm не просто копирует существующие решения, а предлагает собственный подход, основанный на уникальных компетенциях в области энергоэффективных архитектур и управления памятью — технологиях, отточенных в мобильных SoC Snapdragon.

Важно подчеркнуть: Qualcomm не только представляет ускорители, но и возвращается на рынок серверных процессоров. Это указывает на намерение создать полноценную ИИ-платформу «под ключ» — от CPU до NPU и системного ПО.

Qualcomm AI200: оптимизация TCO для массового ИИ-инференса

Qualcomm AI200 позиционируется как решение для массового внедрения ИИ-инференса с акцентом на низкую совокупную стоимость владения (TCO). Платформа ориентирована на выполнение задач инференса больших языковых моделей (LLM) и мультимодальных моделей (LMM), которые сегодня лежат в основе большинства коммерческих ИИ-приложений.

Ключевые особенности AI200:

- Использование проверенной архитектуры NPU Hexagon, применяемой в флагманских SoC Snapdragon;

- Карты с объёмом памяти до 768 ГБ LPDDR — это обеспечивает высокую пропускную способность и снижает задержки при работе с большими моделями;

- Оптимизация под сценарии, где важна не только пиковая производительность, но и экономическая эффективность при длительной эксплуатации;

- Поддержка конфиденциальных вычислений (confidential computing), что критично для корпоративных и государственных заказчиков.

AI200 будет доступен как в виде отдельных ускорителей, так и в составе готовых стоечных решений с полным жидкостным охлаждением, PCIe-коммутаторами для вертикального масштабирования и Ethernet-интерфейсами для горизонтального. Это делает платформу гибкой для развёртывания в различных инфраструктурах — от частных ЦОД до гиперскейлеров.

Qualcomm AI250: революция через Near-Memory Computing

Если AI200 — это эволюция, то AI250 — настоящая революция. Новинка основана на принципиально новой архитектуре Near-Memory Computing (NMC), при которой вычислительные ядра размещаются максимально близко к быстрой памяти. Это позволяет кардинально сократить энергозатраты на перемещение данных и увеличить эффективную пропускную способность памяти более чем в 10 раз по сравнению с традиционными подходами.

Такой подход особенно актуален для современных LLM, где объёмы данных и параметров настолько велики, что «узким местом» становится не вычислительная мощность, а именно пропускная способность памяти и энергопотребление. NMC решает эту проблему на архитектурном уровне.

AI250 также поддерживает дезагрегированный ИИ-инференс — технологию, позволяющую разделять вычислительные, память и сетевые ресурсы и использовать их независимо. Это повышает коэффициент использования оборудования и снижает TCO, особенно в крупномасштабных развёртываниях.

Обе платформы будут поставляться в стойках с энергопотреблением до 160 кВт — на уровне таких решений, как NVIDIA GB200 NVL72. Это ставит Qualcomm в один ряд с лидерами рынка по плотности вычислений.

Программный стек: ключ к успеху, которого не хватало CloudAI 100

Один из главных уроков, извлечённых Qualcomm из неудачи предыдущего поколения ускорителей CloudAI 100, — критическая важность программной экосистемы. В этот раз компания делает ставку на полноценный ИИ-стек гиперскейл-класса, охватывающий все уровни:

- Поддержка ведущих фреймворков машинного обучения (TensorFlow, PyTorch);

- Оптимизированные движки инференса для LLM/LMM;

- Методы дезагрегированного обслуживания моделей;

- Библиотека Efficient Transformers и пакет Qualcomm AI Inference Suite;

- Интеграция с платформой Hugging Face — развёртывание моделей «в один клик»;

- Готовые ИИ-агенты и приложения для ускорения внедрения решений.

Этот подход напоминает стратегию NVIDIA, которая добилась доминирования не только благодаря GPU, но и благодаря экосистеме CUDA, TensorRT и NGC. Qualcomm явно стремится создать аналогичную «программную ловушку», которая удержит клиентов в своей экосистеме.

Интересно, что AMD столкнулась с похожей проблемой: её ускорители MI300X обладают отличными характеристиками, но страдают от недостатка оптимизированного ПО. Qualcomm, похоже, извлекла уроки не только из собственного опыта, но и из ошибок конкурентов.

Первые клиенты и геополитический контекст

Первым крупным заказчиком Qualcomm AI200 и AI250 стал саудовский государственный ИИ-стартап Humain. Компания планирует построить ЦОД мощностью 200 МВт на базе новых чипов, начиная с 2026 года. Это не случайно: Саудовская Аравия активно инвестирует в ИИ-инфраструктуру как часть стратегии диверсификации экономики (Vision 2030).

Ранее Qualcomm уже заключила соглашение с Cerebras — ещё одним игроком на рынке ИИ-ускорителей — о совместном использовании решений в Саудовской Аравии. Это указывает на формирование целой ИИ-экосистемы в регионе, где Qualcomm играет ключевую роль.

Также упоминается Groq — компания, известная своими LPU (Language Processing Units), которые также ориентированы на инференс LLM. Возможно, в будущем мы увидим гибридные решения с участием Qualcomm и Groq.

Сравнение с конкурентами: где Qualcomm берёт преимущество?

Рынок ИИ-ускорителей сегодня доминируют NVIDIA и AMD, но Qualcomm предлагает уникальные преимущества:

| Параметр | Qualcomm AI200/AI250 | NVIDIA GB200 | AMD MI300X |

|---|---|---|---|

| Архитектура памяти | Near-Memory Computing (AI250) | HBM3e | HBM3 |

| Энергоэффективность | Высокая (мобильное наследие) | Средняя/высокая | Высокая |

| Программная экосистема | Новая, но целенаправленная | Лидер (CUDA, TensorRT) | Развивается (ROCm) |

| Дезагрегированный инференс | Да | Частично | В разработке |

| Конфиденциальные вычисления | Да | Да (Confidential Computing) | Да (SEV-SNP) |

| Дата выхода | 2026 (AI200), 2027 (AI250) | 2024 | 2023 |

Главное преимущество Qualcomm — это не пиковая производительность, а энергоэффективность и TCO. В условиях, когда стоимость электроэнергии и охлаждения становится критическим фактором, такие решения могут оказаться более привлекательными для заказчиков, особенно в регионах с высокими тарифами.

Планы Qualcomm: ежегодное обновление и полный ИИ-стек

Компания заявила о намерении придерживаться ежегодного цикла обновления продуктов для ЦОД. Это означает, что AI200 и AI250 — не разовые проекты, а начало долгосрочной стратегии. Цель — достижение лидерства по трём ключевым метрикам:

- Производительность ИИ-инференса;

- Энергоэффективность;

- Минимальная совокупная стоимость владения (TCO).

Возвращение на рынок серверных платформ и развитие собственных CPU позволят Qualcomm предложить клиентам полностью интегрированные решения, оптимизированные на всех уровнях — от кремния до прикладного ПО.

Что это значит для российского рынка?

Хотя анонс сделан в глобальном контексте, российские компании также заинтересованы в энергоэффективных и экономически выгодных ИИ-решениях. В условиях санкционных ограничений и роста стоимости импортного оборудования, альтернативные архитектуры, такие как Qualcomm AI200/AI250, могут стать привлекательными для крупных ЦОД, государственных проектов и корпоративных ИИ-инициатив.

Особенно актуальны будут решения с низким TCO и поддержкой конфиденциальных вычислений — это соответствует требованиям российского законодательства в области защиты персональных данных и критической информационной инфраструктуры.

Для тех, кто планирует развёртывание ИИ-инфраструктуры уже сегодня, Server360.ru предлагает готовые сборки серверов, оптимизированные под задачи машинного обучения и инференса. Наши инженеры помогут подобрать оптимальную конфигурацию с учётом будущей совместимости с новыми платформами.

Как выбрать компоненты для ИИ-сервера уже сейчас?

Пока Qualcomm AI200 и AI250 ещё не поступили в продажу, компании могут готовить инфраструктуру, используя современные компоненты. Вот ключевые рекомендации:

Как собрать ИИ-сервер для инференса в 2025 году

- Определите тип моделей: LLM, мультимодальные, классические ML. Это повлияет на требования к памяти и вычислительной архитектуре.

- Выберите процессор с поддержкой большого объёма RAM и PCIe 5.0. Рассмотрите серверные процессоры Intel Xeon или AMD EPYC.

- Установите максимум оперативной памяти DDR5 ECC — не менее 512 ГБ для средних LLM.

- Используйте быстрые NVMe-накопители для кэширования моделей и данных. Обратите внимание на внутренние SSD-диски с высокой endurance.

- Обеспечьте эффективное охлаждение — предпочтительно жидкостное для высоконагруженных систем.

- Проконсультируйтесь со специалистами — свяжитесь с нашими инженерами для подбора конфигурации под ваши задачи.

Часто задаваемые вопросы (FAQ)

Когда поступят в продажу Qualcomm AI200 и AI250?

Qualcomm AI200 поступит в продажу в 2026 году, а AI250 — в 2027 году. Первые развёртывания запланированы в Саудовской Аравии с участием стартапа Humain.

Чем отличается AI250 от AI200?

AI200 основан на проверенной архитектуре NPU Hexagon и ориентирован на низкий TCO. AI250 использует инновационную архитектуру Near-Memory Computing (NMC), обеспечивающую более чем 10-кратный рост эффективной пропускной способности памяти и значительно более низкое энергопотребление.

Поддерживает ли Qualcomm интеграцию с Hugging Face?

Да, Qualcomm обещает развёртывание моделей с платформы Hugging Face «в один клик» благодаря библиотеке Efficient Transformers и Qualcomm AI Inference Suite.

Почему предыдущие ускорители CloudAI 100 не получили распространения?

Основной причиной была слабая программная экосистема. Qualcomm не предоставила достаточных инструментов для интеграции, оптимизации и развёртывания моделей, что сделало платформу менее привлекательной по сравнению с решениями NVIDIA.